Пользователь @Printblog отметил, что иногда ни Grok, ни ChatGPT не справляются с простыми арифметическими действиями, в частности, с элементарным сложением.

Например, Grok выдал ошибочный результат при подсчете белков (114 г при правильном ответе 132,6 г). В другом случае у ChatGPT получилось 105 г при правильном ответе 137,5.

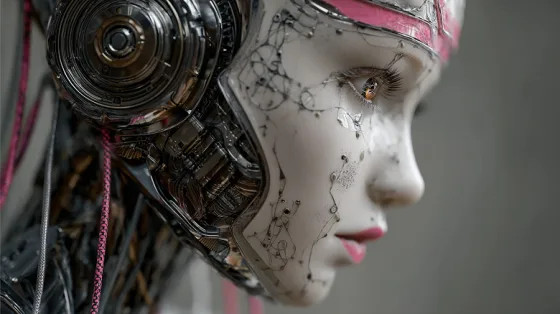

Ранее сообщалось, что большинство моделей ИИ испытывают галлюцинации. Благодаря своей вероятностной архитектуре они иногда выдумывают неправильные ответы. Фактически, более новые модели ИИ, такие как o3 от OpenAI, галлюцинируют больше, чем их предшественники.

Компания xAI Илона Маска отреагировала на сообщения о том, что Grok заявил о геноциде против белых граждан в Южной Африке, заявив, что в бот на базе искусственного интеллекта было внесено несанкционированное изменение.

DayTimeNews.RU

DayTimeNews.RU

СМОТРИТЕ ТАКЖЕ:

СМОТРИТЕ ТАКЖЕ: